2025年7月28日、中国のAI開発企業 Z.ai (旧 Zhipu AI)が、とんでもない性能を持つオープンウェイトの大規模言語モデル「GLM-4.5」をリリースした。

「GLM-4.5」は、推論、コーディング、エージェント能力など各分野のベンチマークで、DeepSeek R1 を大きく上回り、OpenAI o3 や Anthropic Claude 4 Opus と肩を並べる目覚ましいスコアを示している。

しかも、自由度の高いMITライセンスでオープンソース化されているため、誰でもHugging Faceなどからモデルをダウンロードして、ローカル環境で無料で動かせる。

また、Web検索、ブラウザ操作、コード実行などを組み合わせ、PowerPointのスライドまで自動生成してくれる能力を持つなど、最近登場したばかりの「ChatGPT agent」と似た最新機能まで実装されている。

本記事では、そんなリリース直後の最新モデル「GLM-4.5」の概要をまとめるとともに、早速その性能を体感するため、Webで無料で利用する方法、API経由で格安で利用する方法、ローカル環境で利用する方法もそれぞれ紹介する。

新たなDeepSeekショック「GLM-4.5」の脅威の性能とコスパ

Z.ai (旧 Zhipu AI)は、中国のトップ私立大学である清華大学からスピンアウトしたAI開発企業であり、アリババやテンセント、サウジ系ファンドなどから多額の資金を調達している。

Zhipu AIは、2024年10月に前世代モデルの「GLM-4」をリリースし、その後も音声モデルの公開など活発に開発していたが、2025年1月にDeepSeekがリリースした「R1」ほどの性能はなく、それほど注目を集めてこなかった。

今回リリースされた「GLM-4.5」は、DeepSeek R1 以来の中華系オープンソースAIモデルの飛躍的な進歩と言って良いだろう。

早速、ベンチマークテストの結果を見てみよう。

まだ第三者・独立系ベンチマークの結果が出揃っていないが、Z.ai自身が、GLM-4.5とライバル各社のAIモデルにつき、代表的なベンチマークテストの結果を整理して公表している。

「エージェント能力」、「推論・知識」、「コーディング」の3分野について、代表的なベンチマークテスト全12種類の結果を、平均を取ってランキング化したのが以下のグラフである。

GLM-4.5 / GLM-4.5 Air は、誰でもダウンロードして利用できるオープンモデルにも関わらず、OpenAIやxAI、Anthropic、Googleなどが開発する世界トップクラスのモデルに肩を並べている。

同じオープンウェイトのDeepSeek R1 / V3 を大きく上回り、さらには非公開商用モデルの o3 や Grok 4、Claude 4 Opus、Gemini 2.5 Pro などと同等の性能を示しているのだ。

ここで平均値を取っている12種類のベンチマークテストは、いずれもAIモデルの評価でよく用いられる一般的なテストばかりで(MMLU Pro, AIME24, GPQA, SWE-bench Verifiedなど)、強い恣意性は感じない。

Z.ai自身がピックアップした12種のテストによる平均ランキングであるため、多少の有利不利はあるにせよ、少なくともGLM-4.5が一部分野で世界トップクラスの性能を持つことは事実だろう。

また、性能と同じくらいに衝撃的なのは、GLM-4.5の価格設定である。

ランキングでGLM-4.5の前後に位置しているモデルと比べてみると、GLM-4.5はClaude 4 Opusの20分の1という価格破壊レベルの料金設定となっている。

| 企業 | モデル | 入力 / 1Mトークン (非キャッシュ) | 入力 / 1Mトークン (キャッシュ) | 出力 / 1Mトークン |

|---|---|---|---|---|

| Z.ai | GLM-4.5 | $0.60 | $0.11 | $2.20 |

| Z.ai | GLM-4.5-Air | $0.20 | $0.03 | $1.10 |

| OpenAI | o3 | $2.00 | $0.50 | $8.00 |

| OpenAI | o4-mini | $1.10 | $0.275 | $4.40 |

| Anthropic | Claude 4 Opus | $15.00 | $1.50 | $75.00 |

| Anthropic | Claude 4 Sonnet | $3.00 | $0.30 | $15.00 |

| xAI | Grok 4 | $3.00 | $0.75 | $15.00 |

| Gemini 2.5 Pro | $2.50 ($1.25) | $0.625 ($0.31) | $15.00 ($10.00) |

性能も高く、価格も安いとなれば、コーディングなど大量のトークンを消費するタスクで、心強い相棒になるだろう。

もちろん、利用料金といっても、Z.aiの公式APIを使う場合の価格であって、オープンウェイトモデルであるからには自分でGPUを用意できればローカル環境で無料で使うことだって可能だ。

パワポスライドの生成、アプリの生成まで可能

GLM-4.5は、ClaudeやChatGPTで導入されているような、実際に動作するWebアプリを生成できる「Artifacts」や「Full-Stack」機能のほか、PowerPointのスライドをチャットから直接生成できる「AI Slides」機能など、充実した付帯機能群も備えている。

単にモデルを巨大化させて性能を向上させているだけでなく、アプリとしての使い勝手も大きく向上させてきている印象である。

Web検索、コード実行、スライド生成など、複数のツールを組み合わせて自律行動し、複雑なタスクを実行する「エージェント能力」が、上記のベンチマークテストでも高く評価されていたが、実際に使ってみた体感としても、確かにその点が非常に優れていると感じられる。

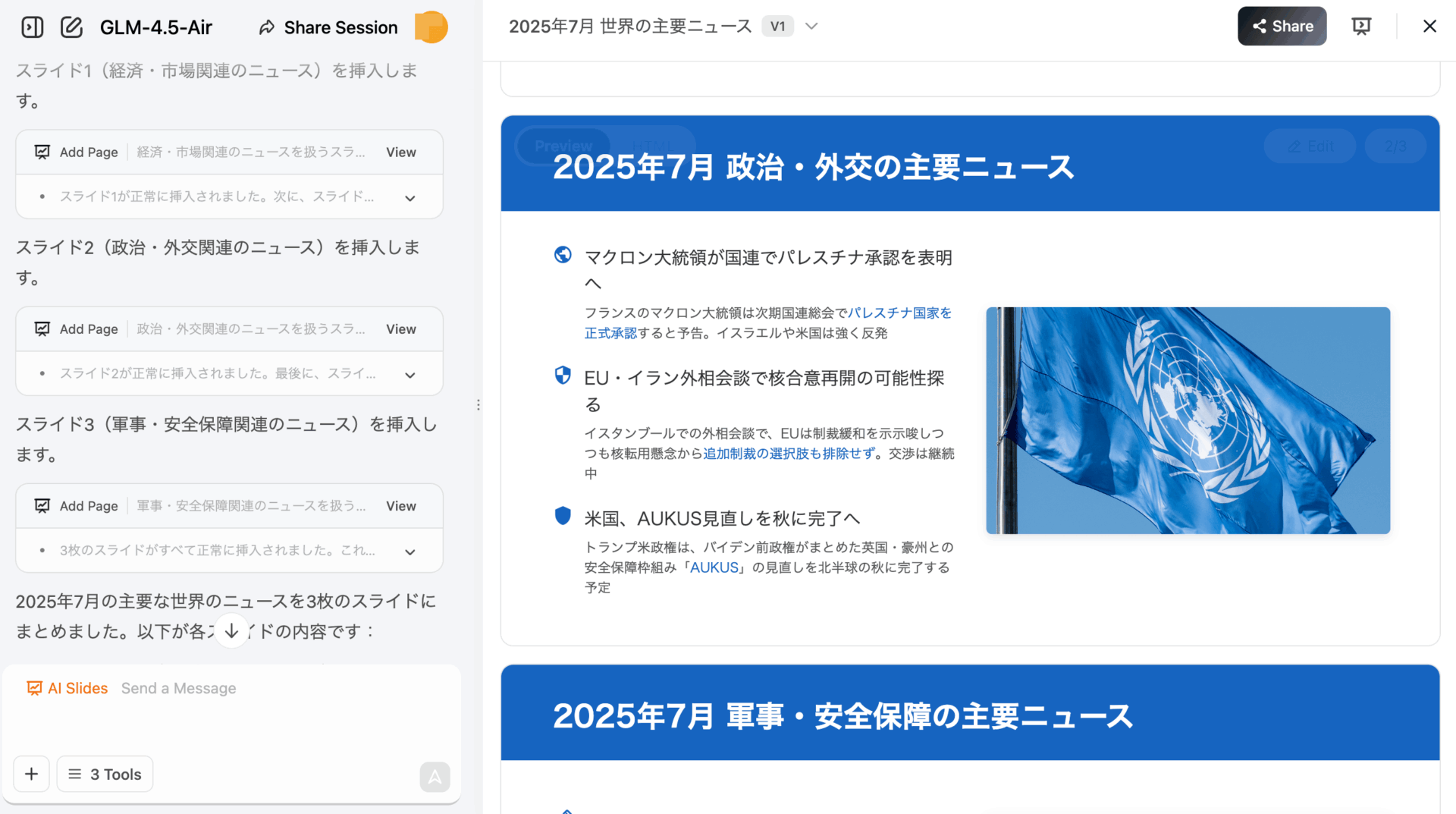

実際に、GLM-4.5にスライドを作らせてみた様子を紹介する。

「AI Slides」機能を有効にした上で、「2025年7月の主要な世界のニュースを、スライド3枚にまとめてください。」と指示してみる。

すると、ウェブ検索と、ページの閲覧、クリックなどのブラウザ操作を組み合わせて、まるで人間のように複雑な思考・アクションを連続的に行なっていることがわかる。

ニュースに関連する画像まで集めてきた上で、最後にPythonコードを実行し、スライドを生成してくれた。

スルスルと勝手に画面が動いて、結構美しいスライドが生成されていく様は、本当に魔法のようである。

検索で収集したニュースを、「経済・市場」「政治・外交」「軍事・安全保障」の3カテゴリに分けてスライドを生成し、適切な画像を組み合わせて、アイコンの色まで揃えて、ちゃんとデザインとして使えるレベルのスライドを生成してくれている。

現在のところ、これだけの高機能を持つモデルを、ブラウザ上で無料で利用できてしまうのだから驚きだ。

なぜすごい?「GLM-4.5」「GLM-4.5 Air」の特徴

Metaの開発するLLamaや、アリババグループの開発するQwen、そしてDeepSeekなど、モデル自体が公開されているオープンソース/オープンウェイトモデルは数多くある。

これらの中でも、今回登場したGLM-4.5は、最高の性能を持つオープンウェイトモデルとなった。

その主要な特徴を簡潔にまとめておくと、以下のようになる。

- Mixture-of-Experts(MoE)による効率性:モデルを複数のサブネットワークに分割し、クエリごとに一部のエキスパートのみを活性化することで処理を高速化

- 大型&軽量の2サイズ展開:「GLM-4.5」3550億パラメータ(320億のアクティブパラメータ)、「GLM-4.5 Air」1060億パラメータ(120億のアクティブパラメータ)

- ハイブリッド推論モデル:GLM-4.5 / GLM-4.5 Air ともに、深い思考ステップを用いる「推論モード」と、瞬時に回答を生成する「非推論モード」を搭載

- 長いコンテキストウィンドウ:12.8万トークンもの入出力が可能で、書籍やコードベースなど膨大なテキストの解析が可能

- エージェント能力ネイティブ:Web検索などのツール使用や、関数やAPIの呼び出しなどが可能なようにモデルが訓練されている

- 自由度の高いライセンス:オープンライセンス(MIT)で、オンプレミスのクローズド利用、商用利用、改変、再配布などが可能

- 26言語への対応:GLM-4.5のユーザーガイドによれば26言語を仮サポートしているとある。筆者が日本語での動作も確認

GLM-4.5は、非常に巨大で高性能なモデルでありながらも、Mixture-of-Experts(MoE)アーキテクチャを採用することで、計算リソースを要する全パラメータを活性化することなく、都度サブセット(320億)のみをアクティブにすることで、計算効率を劇的に向上させている。

また、推論/非推論を切り替えられるハイブリッド設計も、最近のClaudeなどの商用クローズドモデルと同様だ。

o3 や Claude 4 Opus のコンテキストウィンドウが20万とかなり巨大化しているので、コンテキストウィンドウを直接比較すると、若干トップ商用モデルには劣る。

とはいえ、オープンソース/オープンウェイトモデルであっても、おおむね商用のトップモデルと変わらぬ機能や性能を実現しているのは画期的である。

GLM-4.5 を実際に使ってみる方法

「GLM-4.5」ならびに「GLM-4.5 Air」を利用する方法としては、主に以下の3つの手段がある。

- 公式Webインターフェース

- API経由(公式API、OpenRouter)

- ローカル実行

ただし、ローカル実行については、個人では50〜100万円クラスの鬼スペックPCを所有していないと、実用的なスピードで動作させるのは難しいと思われる。

以下、それぞれの使い方を紹介していく。

「Z.ai」公式ウェブアプリで「GLM-4.5」を使う方法

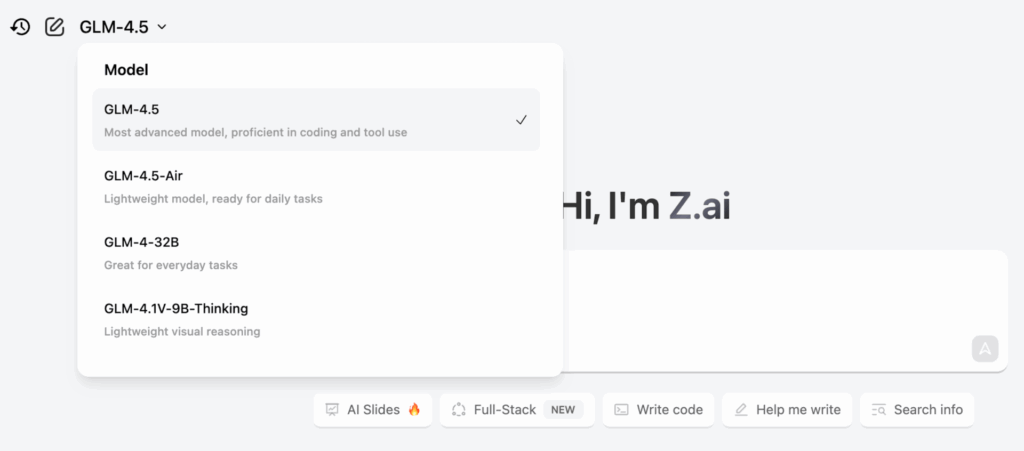

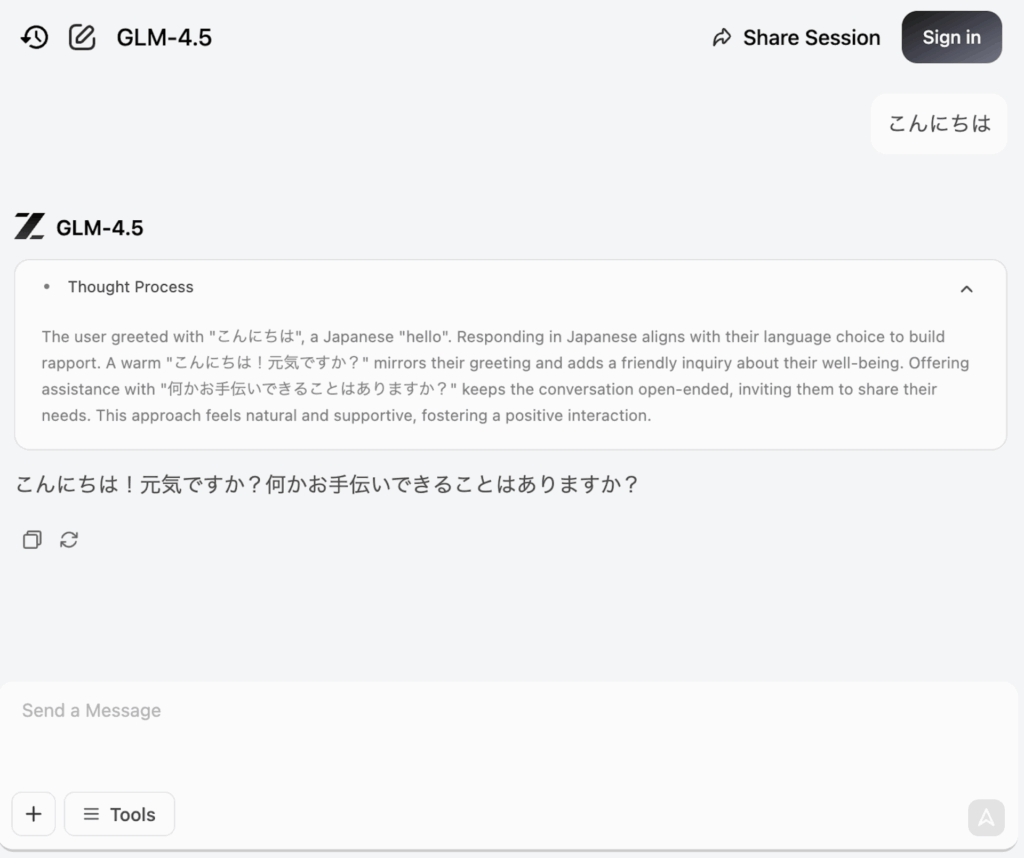

Z.ai は、公式サイト内で、ChatGPTのようなチャットインターフェースを提供している。

GLM-4.5 を試す最も簡単な方法は、この公式Webアプリを使用することである。

こちらのZ.aiチャットページにアクセスすると、会員登録・サインインをしなくても、左上のモデルプルダウンから最新の「GLM-4.5」や「GLM-4.5 Air」を選択することができる。

かなりChatGPTやGeminiなどと似たインターフェースなので、AIチャットアプリを過去に使ったことがあれば、使い方は直感的に理解できるはずである。

日本語も使うことができ、また推論モードがオンになっているので「Thought Process」で思考過程を覗き見ることもできる。

なお、ファイルのアップロードなど、追加機能を利用するには、会員登録が必要である。

会員登録をすれば、利用回数の制限などが明示されていないが、今のところ筆者は無料で利用することができている。

冒頭で紹介したように、「AI Slides」や「Full-Stack」など、スライドやアプリケーションなどをチャットウィンドウの横で生成・レンダリングできる機能もあるので、色々触ってみると非常に楽しい。

公式API /米国ホストAPIで「GLM-4.5」を使う方法

Z.aiは、ウェブアプリだけでなく、APIも提供している。

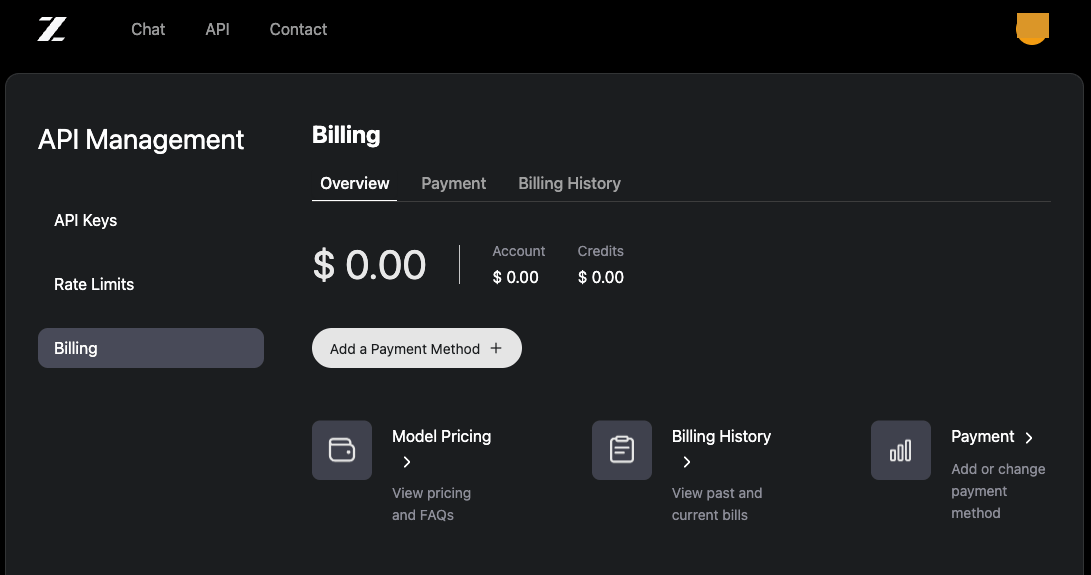

「Z.AI Open Platform」に登録・ログインすると、APIキーの作成や、利用料金のチャージができる。

Z.aiのAPIは、OpenAIのAPI仕様に準拠しているので、OpenAIのモデルを使用している既存コードがある場合でも、最小限の変更で「GLM-4.5」や「GLM-4.5 Air」にモデルを切り替えられる。

例えばPythonであれば公式ドキュメントで解説されているzai SDKを利用する。

ちなみに、Z.aiのプライバシーポリシーを確認すると、Z.aiのグローバル窓口はシンガポール企業であるが、中国本土のグループ企業ともデータが共有されるように読める記載がある。

8 Where We Store Your Personal Data

*中略*

We generally provide the Services from Singapore, and our group companies and their designated service providers are typically located in Singapore and/or China. As a result, your personal data is generally processed in one or both of these countries.

出典:https://chat.z.ai/legal-agreement/privacy-policyこれを気にする場合には、米国企業がホストする「GLM-4.5」や「GLM-4.5 Air」を利用することを推奨する。

オープンソース/オープンウェイトモデルであるメリットの一つは、自分でそのモデルをホストする企業を選択することができる点だ。

開発元企業のAPIを利用しなくとも、同じモデルをクラウドで提供している他のホスティング企業のAPIを使えば、データの送信先をコントロールすることができる。

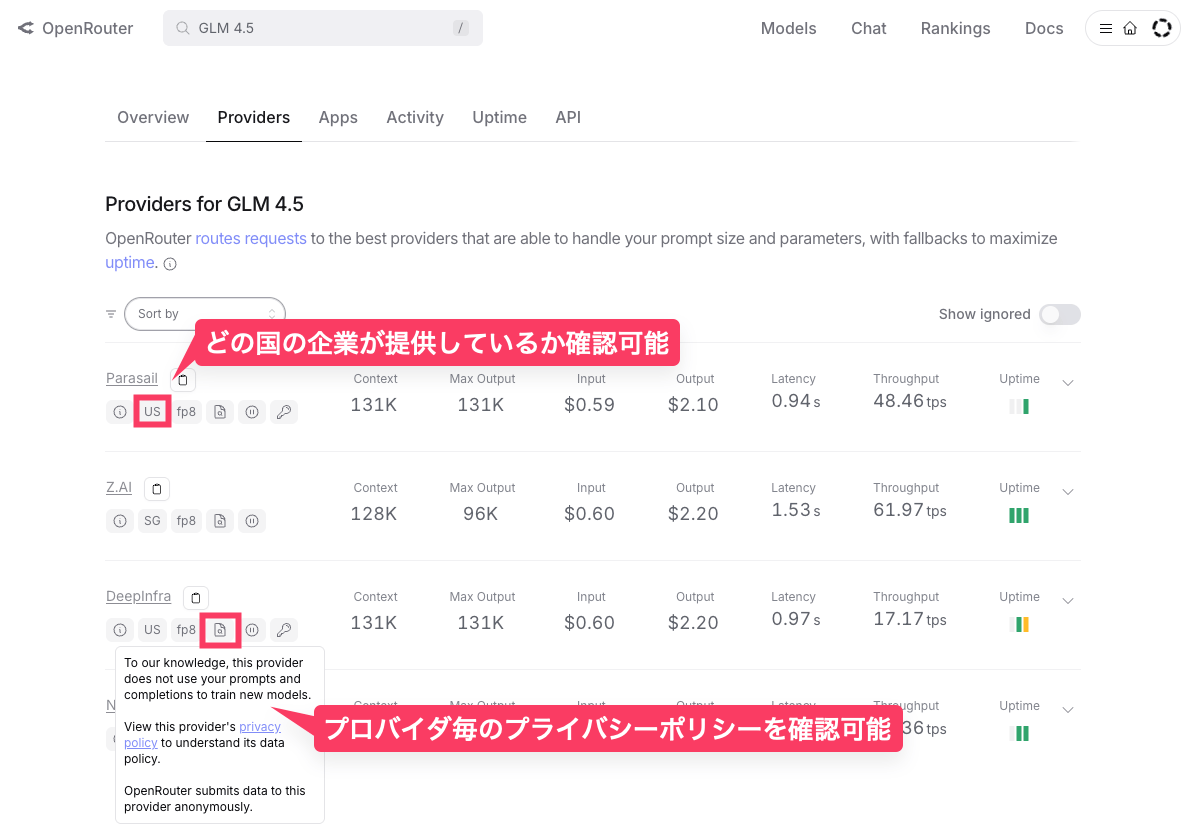

例えば、「OpenRouter」という複数のホスティングサービスを一箇所で使えるサービスで「GLM-4.5」を提供しているプロバイダを調べると、米国企業が3社提供していることがわかる。

OpenRouter上で、モデルを提供している企業の所在国やプライバシーポリシーを一律で確認できるので、避けたい企業があればチェックできる。

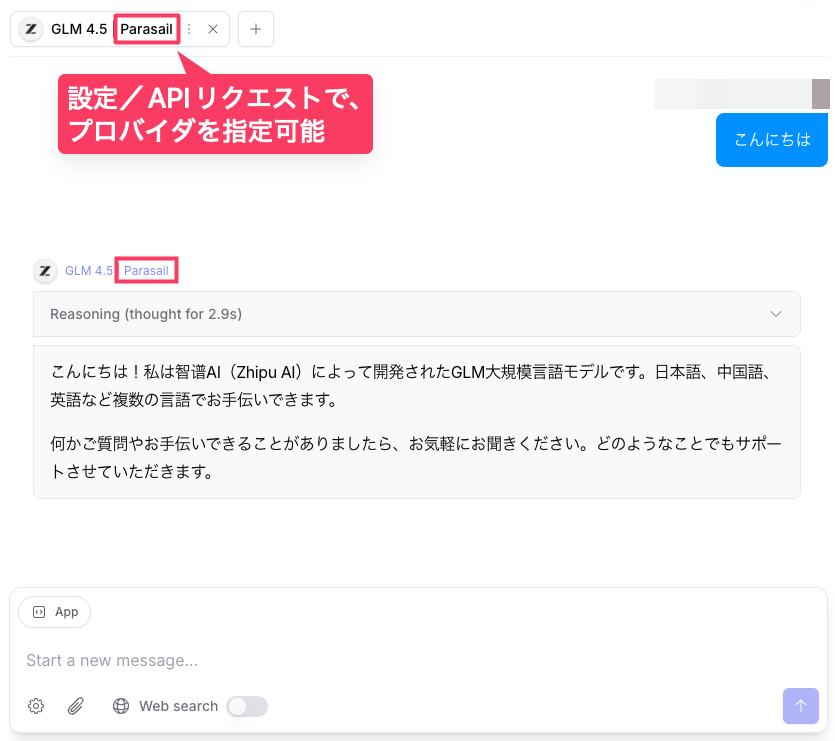

本来は、OpenRouterが、その時々で最善のプロバイダを自動選定してルーティングしてくれるのがメリットなのだが、「米国のサーバーしか使いたくない」といったニーズがあれば、予め指定しておくことも可能だ。

OpenRouter上のチャットインターフェースのモデル設定や、実際のAPIコールの中で特定のプロバイダを指定できるので、そこで米国に本社があるホスト企業(例:Parasail)を指定すれば、米国で動作するGLM-4.5を利用できる。

ローカルで「GLM-4.5 / GLM-4.5 Air」を実行する選択肢

Z.aiは、GLM-4.5とGLM-4.5-Airのモデル本体を、Hugging Faceなどの公開リポジトリでリリースしているため、これをダウンロードしてくれば、自分のハードウェア上で動かすことも可能である。

ただし、とんでもないスペックのPCが必要になるので、ほとんどの個人にとっては、クラウドやAPIを使用する方が現実的だ。

例えば、Ivan FioravantiというXユーザーが、128GBメモリを積んだM4 Max MacBook Proで、GLM-4.5 Airの4ビット量子化版を利用しているビデオを投稿している。

現在、Apple公式サイトで、M4 Max Mac Studioの128GBメモリのモデルは「553,800円」から購入することができる。

わずか50万円で、Claude 4 Sonnetに匹敵する性能を持つ「GLM-4.5 Air」を、自分のPCローカルで使い放題と考えると、安いような気もするが、気軽に試せる値段ではない。

まだまだローカルAIモデルのためにMac Studioに重課金する個人ユーザーは少ないだろう。

しかし、企業にとっては、モデルの高性能化と、ハードウェアの低価格化が、かなり実用的・現実的な水準まで進んでいるとも言えよう。

個人情報や機密情報など、対外的に送信できないセンシティブなデータを扱う企業などであれば、これまでAIで処理できなかったデータを、Mac Studioを買ってくるだけで、GLM-4.5 Airを使ってローカル処理できる可能性がある。

有料版ChatGPTレベルのAIが無料で無数に存在する未来へ

GLM-4.5 / GLM-4.5 Air は、実際に筆者が文章作成やコーディング中に使用している中でも、ベンチマークの通り、非常に高い性能を持っていることを体感できる水準のモデルだ。

これまでも、DeepSeek R1 や アリババの Qwen、Meta の Llama など、モデル自体の能力が高い大型オープンソースモデルは多数登場してきたが、今回の「GLM-4.5」は、単にモデル性能が高いだけでなく、「AIエージェント・アプリケーション」としての完成度の高さもトップクラスに近づいている、という点が斬新だと感じる。

Z.ai のWebアプリで使用できる「GLM-4.5」は、ChatGPTでいう「Agent」機能や「Canvas」機能、Claudeでいう「Artifacts」機能などと似たような機能を備え、しかもそれが非常にスムーズに実装されている。

「AI Slides」などは独自の味付けが加えられた機能で、ビジュアル的に美しいスライドが瞬時に生成され、スライドの表示・ダウンロード等もとても使いやすく、ユーザーエクスペリエンスとして良質だった。

(Webから収集してきた画像が埋め込まれたスライドが、著作権的にどうなのかは置いておいて・・・。)

中国のAI企業が、米国のトップAI開発企業のモデル性能に追いつくだけでなく、アプリとしての利便性でも頭角を現しつつあるように思える。

また、2025年の時点で、このレベルのモデルを、50万円のMacでローカルで動かせるようになった、ということで、今後数ヶ月〜数年でのAI業界の発展も非常に楽しみだ。

この先、GLM-4.5クラスの性能を持つモデルが、あらゆる端末・アプリ・サービスに組み込まれ、個人も企業も、皆が自分だけのAIモデルを操る日も近いかもしれない。