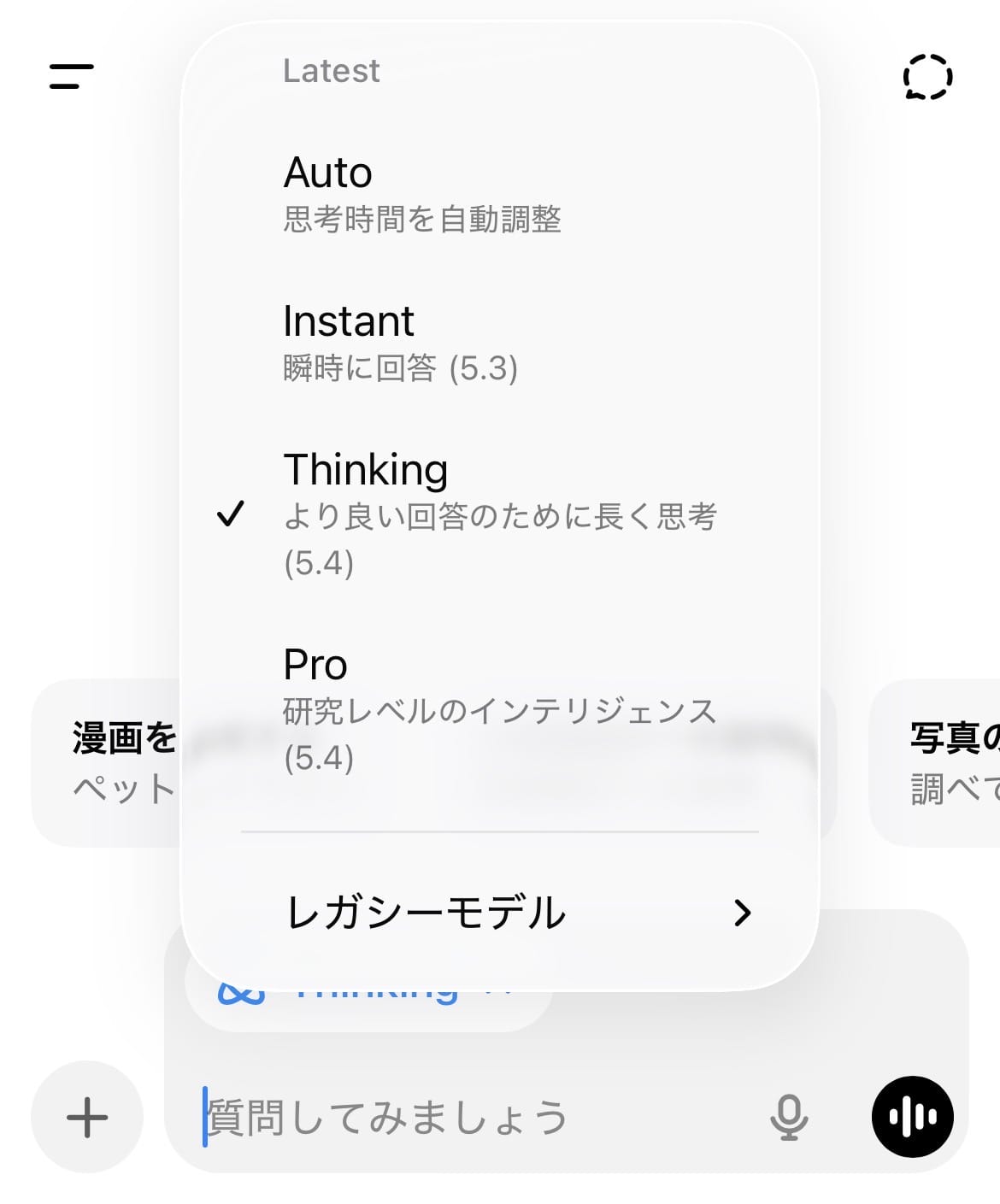

2026年3月5日、OpenAIが最新フラッグシップモデル「GPT-5.4」を発表した。ChatGPT、API(gpt-5.4)、Codexで即日利用可能で、上位版「GPT-5.4 Pro」(gpt-5.4-pro)も同時にリリースされた。

最大の注目点は、OpenAI初の「ネイティブ・コンピュータ操作機能」だ。デスクトップ操作ベンチマーク「OSWorld」で75.0%を記録し、人間の成功率72.4%を初めて上回った。画面を見てクリックし、コードを書いて実行する。汎用モデル自身がPC操作能力を持つ時代が来た。

ナレッジワーク性能の飛躍も見逃せない。44職種の実務タスクで人間の専門家と比較するベンチマーク「GDPval」では勝率83.0%を達成し、前モデルGPT-5.2の70.9%から12ポイント以上改善された。5回中4回、プロの仕事に勝てるAIが現実のものとなった。

わずか2日前にチャット専用「GPT-5.3 Instant」が出たばかりだが、GPT-5.4は本筋の「Thinking」モデル最新版であり、GPT-5.2 Thinkingの後継にあたる。Claude Opus 4.6やGemini 3.1 Proとの三つ巴の競争も激化しており、得意分野による使い分けがますます重要になっている。

GPT-5.4の概要

GPT-5.4 Thinkingは、ChatGPT上ですでに利用できる。

GPT-5.2から全体的に性能が向上しており、特にExcel操作などのナレッジワーク、ウェブ検索、複雑な推論などでベンチマークが改善している。

推論性能の改善以外では、今回のアップデートの注目点は以下の通りだ。

- ネイティブ Computer Use: 汎用モデル自身がコンピュータ操作能力を持つOpenAI初のモデル。

- 推論効率の大幅な向上: GPT-5.2と比較して、同等の問題を大幅に少ないトークンで解決する。OpenAIは「最もトークン効率の良い推論モデル」と謳っている。

- 事実精度の改善: 主張が誤りである確率がGPT-5.2比で33%低下、レスポンス全体にエラーを含む確率が18%低下した。

- 1Mトークン・コンテキストウィンドウ: Codex・APIで最大100万トークンのコンテキストに実験的に対応。コードベース全体や大量のドキュメントを一括で処理できる。

- Tool Searchによるトークン47%削減: API利用時、従来はすべてのツール定義をプロンプトに含める必要があったが、GPT-5.4では軽量なツール一覧と検索機能だけを渡し、必要なときだけ定義を取得する仕組みに。

また、ChatGPTのUI上の改善として、GPT-5.4 Thinkingでは、複雑なクエリに対して思考の事前計画が表示されるようになった。ユーザーは思考の途中で方向を修正する指示を追加でき、やり直しの手間が減る。

Deep Researchの精度も向上しており、特に詳細なクエリに対してより的確な情報を収集できるようになっている。BrowseCompベンチマークで82.7%(GPT-5.2: 65.8%)というスコアが、その実力を裏付けている。

前世代「GPT-5.2」とのベンチマーク比較

GPT-5.2からの改善幅を把握するため、主要なベンチマークを一覧で比較する。

| ベンチマーク | GPT-5.4 | GPT-5.4 Pro | GPT-5.2 | GPT-5.2 Pro |

|---|---|---|---|---|

| GDPval(ナレッジワーク) | 83.0% | 82.0% | 70.9% | 74.1% |

| OSWorld-Verified(デスクトップ操作) | 75.0% | — | 47.3% | — |

| SWE-Bench Pro(コーディング) | 57.7% | — | 55.6% | — |

| Terminal-Bench 2.0(ターミナル操作) | 75.1% | — | 62.2% | — |

| BrowseComp(Web検索) | 82.7% | 89.3% | 65.8% | 77.9% |

| Toolathlon(ツール使用) | 54.6% | — | 45.7% | — |

| GPQA Diamond(科学推論) | 92.8% | 94.4% | 92.4% | 93.2% |

| ARC-AGI-2(抽象推論) | 73.3% | 83.3% | 52.9% | 54.2% |

| Humanity’s Last Exam(ツール有) | 52.1% | 58.7% | 45.5% | 50.0% |

| MMMU Pro(視覚推論、ツール無) | 81.2% | — | 79.5% | — |

ほぼすべてのベンチマークで改善が見られるが、特にOSWorld(+27.7pt)、BrowseComp(+16.9pt)、ARC-AGI-2(+20.4pt)、GDPval(+12.1pt)、Terminal-Bench 2.0(+12.9pt)の改善幅が際立っている。

一方で、GPQA DiamondやSWE-Bench Proなど、GPT-5.2の時点で既に高水準だったベンチマークでの改善は小幅にとどまっている。コーディング能力はGPT-5.3-Codexの統合により底上げされているものの、劇的な飛躍というよりは着実な進歩という印象だ。

競合モデルとの比較:vs Claude Opus 4.6, Gemini 3.1 Pro

OpenAI, Anthropic, Googleから立て続けにモデルがリリースされ、GPT-5.4(3月5日)、Claude Opus 4.6(2月4日)、Gemini 3.1 Pro(2月19日)の3モデルが拮抗している。

それぞれ得意分野が異なり、全分野を制覇するモデルはまだ現れていない。

| ベンチマーク | GPT-5.4 | Claude Opus 4.6 | Gemini 3.1 Pro |

|---|---|---|---|

| GDPval(ナレッジワーク) | 83.0% | 78.0% | — |

| OSWorld(デスクトップ操作) | 75.0% | 72.7% | — |

| GPQA Diamond(科学推論) | 92.8% | 91.3% | 94.3% |

| ARC-AGI-2(抽象推論) | 73.3% | 75.2% | 77.1% |

| MMMU Pro(視覚推論) | 81.2% | 85.1% | 80.5% |

| BrowseComp(Web検索) | 82.7% | 84.0% | 85.9% |

| SWE-Bench Verified(コーディング) | — | 80.8% | 80.6% |

| Terminal-Bench 2.0(ターミナル操作) | 75.1% | 65.4% | 68.5% |

| MCP Atlas(ツール連携) | 67.2% | 約59.5% | 69.2% |

以上を見ると、3モデルの大まかな傾向として以下のような強みがある。

- GPT-5.4が強い領域: ナレッジワーク(GDPval 83.0%)、コンピュータ操作(OSWorld 75.0%)、ターミナル操作(Terminal-Bench 75.1%)。ビジネス文書の作成やPC自動化に関してはGPT-5.4が最適解となる

- Gemini 3.1 Proが強い領域: 科学推論(GPQA Diamond 94.3%)、抽象推論(ARC-AGI-2 77.1%)、Web検索(BrowseComp 85.9%)。推論力の高さを最低価格帯で提供しており、コスパは3モデル中最高だ

- Claude Opus 4.6が強い領域: 本番環境のコーディング(SWE-Bench Verified 80.8%)、視覚推論(MMMU Pro 85.1%)。バグ修正やコードレビューなど精密なコーディングタスクではOpusが依然としてトップだ

SWE-Bench VerifiedとSWE-Bench Proは異なるベンチマークセットであり、難易度も異なる。Opus 4.6の80.8%(Verified)とGPT-5.4の57.7%(Pro)を直接比較することはできない点に注意が必要だ。

ChatGPT for Excel / Google Sheetsもついに登場

GPT-5.4の発表と同時に、OpenAIは「ChatGPT for Excel」のベータ版も公開した。GPT-5.4をエンジンとするExcelアドインで、ワークブック内にChatGPTが常駐し、言葉での指示だけでシートの更新・複雑な分析集計・モデル構築まで実行できる。

米国・カナダ・オーストラリアのみのリリースで、残念ながらまだ日本で使用することはできない。

主な特徴は以下の通りだ。

- 自然言語でスプレッドシートを操作: 「このデータからDCFモデルを作って」のように指示すると、数式・構造・書式を維持したまま、ライブのExcelモデルを直接作成・更新する

- ワークブック全体を横断的に理解: シート間の数式の依存関係を追跡し、エラーの原因特定や前提条件の変更影響を説明する。前任者が作った複雑なスプレッドシートの解読にも対応する

- 変更前に確認を求める: ChatGPTはセルを編集する前に許可を求め、変更箇所と参照セルへのリンクを表示する。計算はExcel内で実行されるため、数式の監査・検証が可能だ

金融業界向けには、FactSet(近日対応)、Moody’s、Dow Jones Factiva、MSCI、Third Bridge、LSEG、S&P Globalなどのデータプロバイダとの統合も発表された。市場データ・企業情報をChatGPT内のワークフローに直接取り込むことができる。さらに、MCP(Model Context Protocol)を使って社内独自データとの接続も可能だ。

再利用可能な「Skills」として、決算プレビュー、コンパラブル分析、DCF分析、投資メモの作成テンプレートも提供される。

現時点ではベータ版として、ChatGPT Business / Enterprise / Edu / Pro / Plusユーザーに提供されている(米国・カナダ・オーストラリアのみ)。Google Sheets版は近日公開予定だ。

競合「Claude in Excel」はすでにグローバル展開

実は、同様のExcelアドインは競合のAnthropicも先行してリリースしている。

Claude in Excelは日本を含むグローバルで利用可能だ。日本でAIのExcelアドインをどうしても使いたい人は、ChatGPTよりもClaudeを契約した方が良いかもしれない。

ClaudeのExcelアドインについては、過去記事「Claude in Excelの使い方完全ガイド」で詳しく紹介している。

両者の機能はほぼ同じだ。データの構造をAIが理解した上で回答してくれるので、いちいちデータの構造をAIに伝える必要がない。また、関数式まで勝手に書いてくれるので、人間が手作業をする必要すらなく、Excelでのデータ分析が非常に楽になる。

プレゼンから会計まで、44職種でプロを超える

GPT-5.4のベンチマークで、前モデルから大幅に改善しているのが、ナレッジワーク(知識労働)における性能だ。

OpenAIが開発した「GDPval」ベンチマークは、米国GDPの上位9産業・44職種にわたるプロフェッショナルの実務タスク(営業プレゼン、会計スプレッドシート、医療スケジュール、製造図面など)をAIに実行させ、人間の専門家と比較する評価手法である。

GPT-5.4はここで、人間の専門家の成果物と比較して一致または上回った割合が83.0% に達した。GPT-5.2の70.9%から12ポイント以上の改善だ。

特に目立つのは、スプレッドシート関連の能力向上である。投資銀行のジュニアアナリストが行うようなスプレッドシートモデリングの内部ベンチマークで、GPT-5.4は平均スコア87.3%を達成した。GPT-5.2は68.4%だった。

プレゼンテーション作成でも、GPT-5.2との比較評価において人間の評価者が68%の確率でGPT-5.4の出力を好んだという結果が出ている。理由として、より洗練されたデザイン、視覚的バリエーションの豊富さ、画像生成の効果的な活用が挙げられている。

人間を超える「Computer Use」能力

GPT-5.4の中でもっとも革新的な点は、ネイティブのコンピュータ操作機能の追加だろう。

GPT-5.4のComputer Useには、大きく分けて二つのアプローチがある。

- スクリーンショット認識型: 画面のスクリーンショットを見て、マウスクリックやキーボード入力といったUI操作を指示する。人間がPCを操作するのと同じ感覚だ

- コード実行型: Playwrightなどのブラウザ自動化ライブラリのコードを直接書いて実行する。GPT-5.4はこの方式で特に高い性能を発揮するよう明示的に訓練されており、DOM操作や条件分岐を含む複雑なワークフローに強い

デスクトップ操作ベンチマーク「OSWorld」では、GPT-5.4は**人間の成功率72.4%を上回る75.0%**を記録した。

| ベンチマーク | GPT-5.4 | GPT-5.2 | 人間 |

|---|---|---|---|

| OSWorld-Verified(デスクトップ操作) | 75.0% | 47.3% | 72.4% |

| WebArena-Verified(ブラウザ操作) | 67.3% | 65.4% | — |

| Online-Mind2Web(ブラウザ操作) | 92.8% | — | — |

GPT-5.2の47.3%からの跳躍は、わずか数ヶ月での27.7ポイント改善であり、驚異的なペースだ。

Computer Useの精度を支えているのが、視覚認識能力の向上である。画像入力に「original」モードが追加され、スクリーンショットを最大1,024万ピクセルのフル解像度で処理できるようになった。これにより、小さなボタンや細かいテキストも正確に認識してクリックできる。ドキュメント解析ベンチマーク「OmniDocBench」でもエラー率が0.140から0.109に改善されている。

GPT-5.4の「Computer Use」を試す方法

このComputer Use機能は、現時点ではAPIとCodexで利用できる。ChatGPTの通常のチャット画面から直接使える機能ではない。

一般のChatGPTユーザーにとっては、視覚認識の改善や推論精度の向上といった間接的な恩恵が中心となる。

開発者にとっては、GPT-5.4にUI/UXのデバッグや改善を行わせることができ、恩恵が大きい。

APIでの利用

Responses API(v1/responses)でcomputerツール({"type": "computer"})を指定して呼び出す。公式ドキュメントでは、3つの利用パターンが紹介されている。

- ビルトインComputer Useループ: モデルにスクリーンショットを渡すと、クリック・入力・スクロールなどの操作指示(

computer_call)が返ってくる。開発者側でその操作を実行し、新しいスクリーンショットを返す、というループを繰り返す方式 - カスタムツール・ハーネス: 既存のPlaywright・Selenium・VNC等の自動化基盤がある場合、それを通常のfunction callingのツールとして公開し、モデルに操作させる方式

- コード実行ハーネス: モデルにPlaywright等のコードを直接書かせて実行する方式。GPT-5.4はこの方式で特に高い性能を発揮するよう明示的に訓練されている

いずれの方式でも、操作対象のブラウザやVMはサンドボックス環境で隔離して実行し、高リスクな操作(データ削除、送信、決済など)の前にはユーザー確認を挟む設計が推奨されている。

Codexでの利用

OpenAIのコーディングエージェント(アプリ版・IDE拡張・CLI・Web版)でGPT-5.4を選択すると恩恵を受けられる。実験的なスキル「Playwright (Interactive)」も公開され、Codex上でWebアプリの視覚的デバッグが可能になった。

料金体系: トークン単価は上昇も、効率化で相殺?

GPT-5.4のAPI価格はGPT-5.2より引き上げられている。

OpenAIは「推論効率の向上でトータルコストは下がる」と主張しているが、これはユースケースによって真偽が分かれうるため、実際の利用パターンで検証する必要がある。

| モデル | 入力(100万トークン) | キャッシュ入力 | 出力(100万トークン) |

|---|---|---|---|

| GPT-5.2 | $1.75 | $0.175 | $14 |

| GPT-5.4 | $2.50 | $0.25 | $15 |

| GPT-5.2 Pro | $21 | — | $168 |

| GPT-5.4 Pro | $30 | — | $180 |

272Kトークンを超えるリクエストでは、入力が2倍($5/M)、出力が1.5倍($22.50/M)に跳ね上がる。

なお、フロンティアモデルの中でのGPT-5.4の価格帯を整理すると、以下のようになる。

| モデル | 入力(100万トークン) | 出力(100万トークン) | コンテキスト長 |

|---|---|---|---|

| Gemini 3.1 Pro | $2 | $12 | 200万トークン |

| GPT-5.4 | $2.50 | $15 | 100万トークン(Codex)/ 272K |

| Claude Sonnet 4.6 | $3 | $15 | 20万トークン(100万ベータ) |

| Claude Opus 4.6 | $5 | $25 | 20万トークン(100万ベータ) |

| GPT-5.4 Pro | $30 | $180 | 100万トークン(Codex)/ 272K |

GPT-5.4の標準版はGemini 3.1 Proに近い価格帯に位置しており、フロンティアモデルとしては比較的手頃だ。

一方、GPT-5.4 Proは群を抜いて高額であり、最高性能を求める場面に限定される。

コンテキスト長ではGemini 3.1 Proの200万トークンが圧倒的に大きい。大規模なコードベースや長文ドキュメントを一括処理する用途では、Geminiが有利になる場面が多いだろう。