2025年1月31日、OpenAIが新たな推論モデル「o3-mini」をついに一般公開した。これは、昨年12月に予告されていた「o3」シリーズの第一弾となる。

ChatGPTの無料ユーザーでも、最新の「o3-mini」を使用できるようになり、史上初めて、課金なしでも非常に能力の高い「推論モデル」(o1, o3系のモデル)を利用できるようになった。

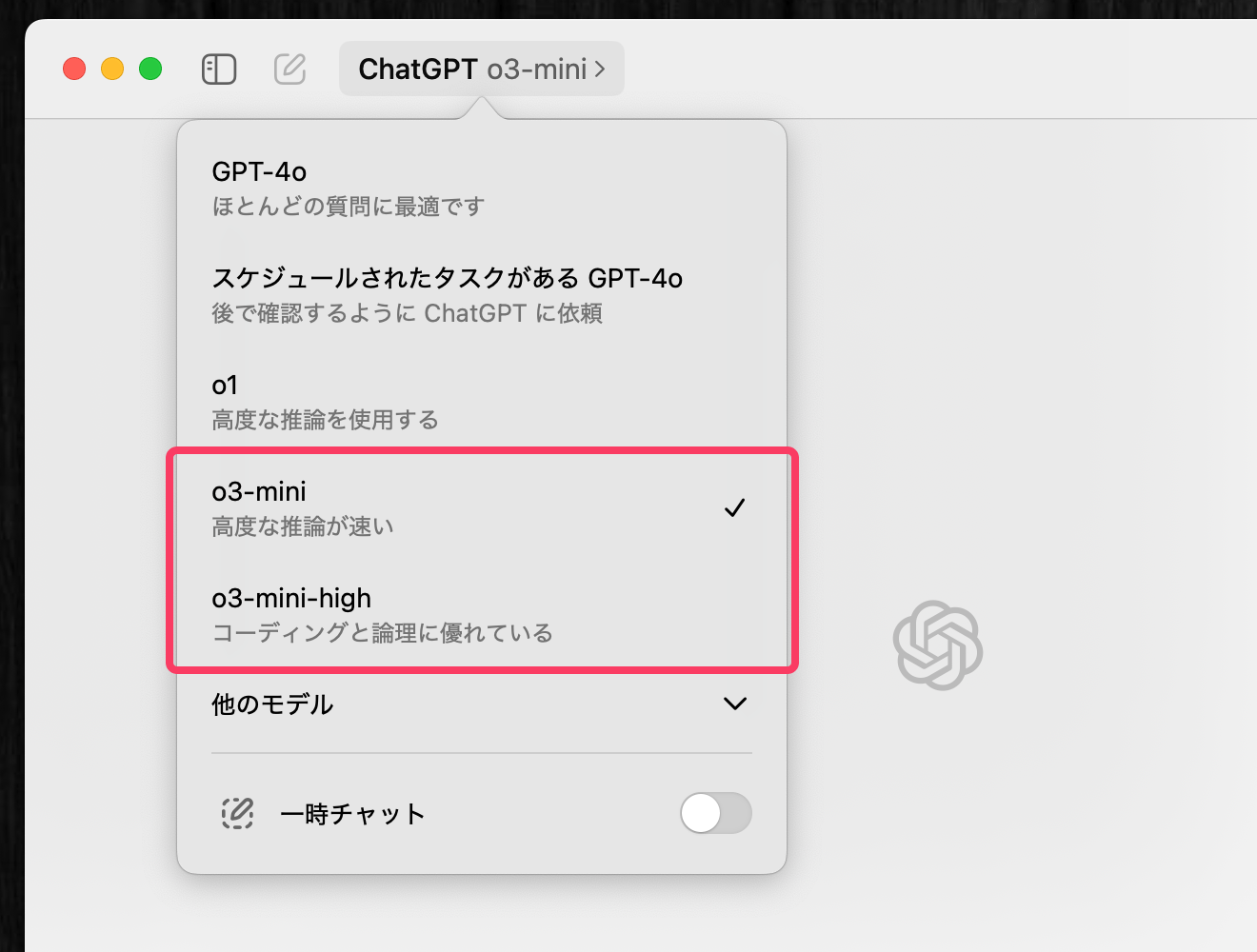

また、有料版のChatGPT Plusユーザーは、通常の「o3-mini」に加えて、「o3-mini-high」という更に推論能力の高いモデルを利用することもできる。

o3-miniのリリース当日には、サム・アルトマン氏ほかOpenAIの開発陣が、アメリカの大手掲示板サイト「Reddit」にて、ユーザーからの質問を公開で受け付ける「Ask Me Anything (AMA)」イベントを実施した。

本記事では、このOpenAIによるReddit AMAで初めて明らかになった未公開情報についてもまとめる。

o3-mini / o3-mini-high の使い方、最新のベンチマーク、APIユーザーがo3-miniを利用可能にする方法など、o3-miniに関する情報を総まとめしているので、最新情報へのキャッチアップに活用してほしい。

無料ユーザーにも開放!o3-miniの使い方

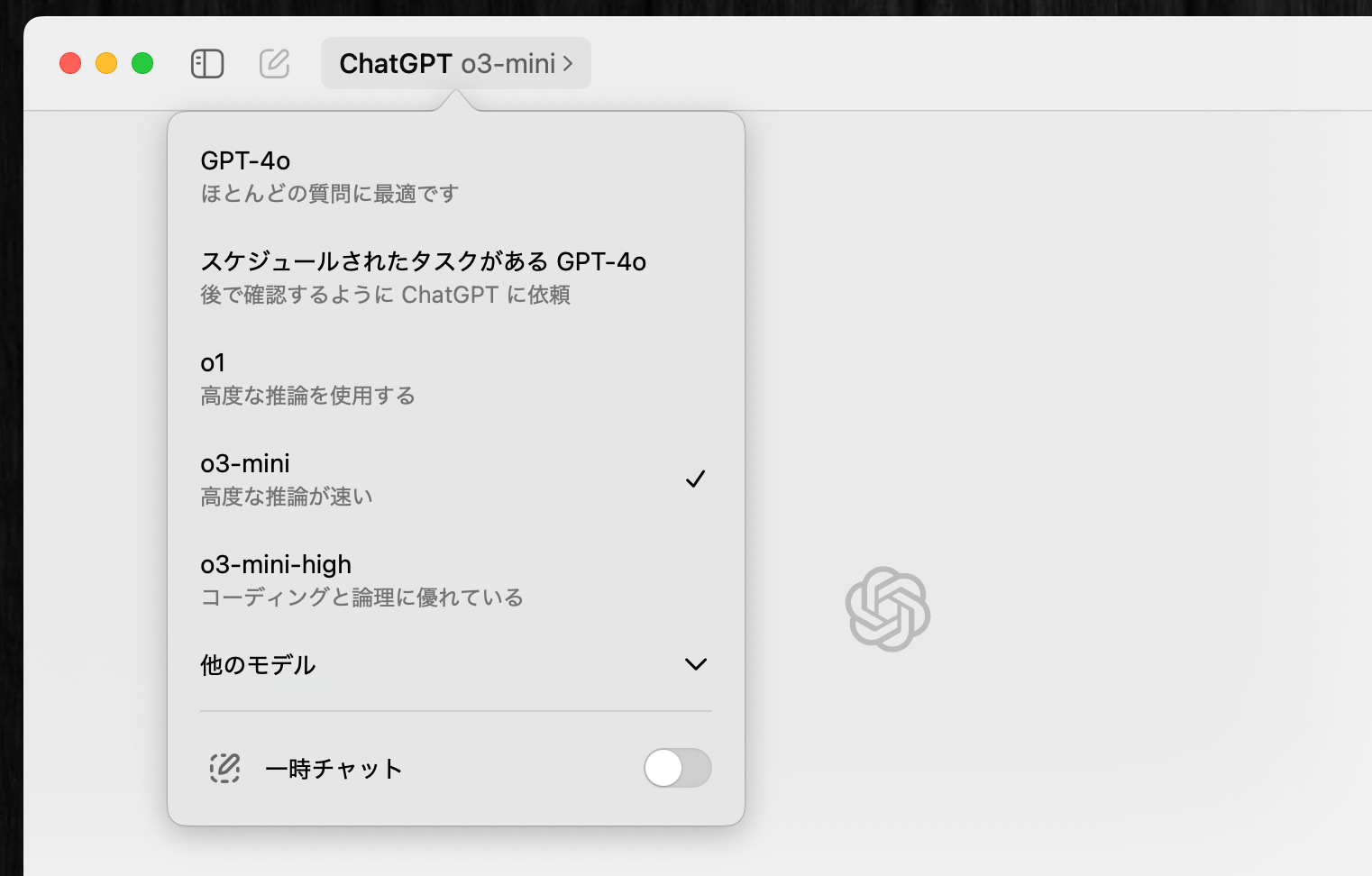

o3-miniは、ChatGPTに早速実装され、Web版、デスクトップ版、スマホ版で利用可能になっている。

無料ユーザーであっても、ChatGPTに会員登録&ログインすればo3-miniが利用可能だ。

無料ユーザーの回数制限は明示されていないものの、Reddit上などでは、10メッセージで上限に達し、5時間でリセットされた、といった事例が紹介されており、無料でもかなり使えるかもしれない。

チャットボックスの下部にある「推論」ボタンをオンにすれば、o3-miniを使用した回答が得られる。また、その状態でWeb検索機能もオンにすることができる。

有料版のユーザーは、従来のo1モデルも含め、以下のモデルを利用できる。毎日150回ものクエリをo3-miniで利用できるほか、無料版では利用できない更に高性能なモデル「o3-mini-high」が利用できるようになっている。

| 推論モデル | 利用回数上限 (Plus) | 利用回数上限 (Pro) |

|---|---|---|

| o3-mini | 150回 / 日 | 無制限 |

| o3-mini-high | 50回 / 週 | 無制限 |

| o1 | 50回 / 週 | 無制限 |

モデルのネーミングが分かりにくいため、うっかり推論能力のないGPT-4oばかり使っている、なんてことがないようにしたい。

ChatGPTを利用するときは、画面左上のモデルセレクターを意識して、GPT-4oでうまく回答が得られないときは、上位のモデルを試してみる事を習慣付けた方がいい。

これだけ無料利用枠が大きいのは、話題の中国産・推論モデル「DeepSeek R1」が、1日50回も無料で利用可能であることを受けて、価格競争が激化した結果と言えるかもしれない。

o3-miniのベンチマーク:総合力が高く、コーディングは圧倒的

リリース直後ではあるが、各種ベンチマークサイトを見ても、すでにo3-miniが上位を席巻している。

ちなみに、o3-miniといっても1種類ではなく、思考する量(reasoning effort)に応じて、低(low)、中(medium)、高(high)の3つのモードがある。

公式のドキュメントで明記されていないため確証はないが、おそらくChatGPT無料版で利用できるのは、最も思考時間の短い「o3-mini-low」であろうと思われる。

以下、代表的なベンチマークテストのランキングを確認してみよう。

記事執筆現在、常に新しい問題を追加することで、正確性の高いランキングを目指している「Livebench」では、「o3-mini-high」が総合ランキングトップだ。

また、無料で利用できる「o3-mini-low」でさえ、Gemini 2.0 thinkingやDeepSeek R1などの他社の推論モデルに肉薄している。

中でも、o3-miniシリーズのプログラミングの能力は注目に値する。

上記のLivebenchの表では、カテゴリごとにスコアが出ているが、「Coding Average」カテゴリでのo3-mini-highのスコアは82.74と、他者を圧倒していることが分かる。

OpenAIのニュースリリースによれば、o3-miniの3モデルは、競技プログラミングサイトであるCodeforcesにおけるELOレートでも、以下のスコアを叩き出している(12月の発表時よりもさらにスコアが向上している)。

o1のスコアは1891なので、有料版で使える「o3-mini-high」であれば、現状のOpenAIが提供している全てのモデルの中で、最高の性能を有している。

無料版の「o3-mini-low」ですら、o1のスコアに肉薄しているので、コーディングアシスタントとしてLLMを利用する場合には、o3-miniは非常に有力な選択肢となりうる。

o3-miniはAPI価格も大幅値下げ!API利用法まとめ

ChatGPTは、月額20ドルと固定のサブスクリプション料金で利用できるので、モデルごとのコストの違いはあまり関係がない。

一方、開発者の場合には、APIを通してトークンごとの従量課金で利用料を支払うことになるので、モデルの運用コストの低下は非常にありがたい。

o3-miniは、これだけ性能が高いにも関わらず、圧倒的に安く、高速化しているので、開発者にとっても良いことずくめだ。

GPT-4oより安価!全部o3-miniに投げよう

o3-miniにアップデートされ性能が向上したので、価格も上昇しそうなものだが、o1-miniと比べて、むしろ価格は下落している。

以下は、100万トークンの入出力にかかる料金を、モデル別に整理した表である。

API利用料は、入出力ともに、o1やo1-miniと比べると、3分の1から15分の1もの大幅な値下げが行われている。

| モデル | 入力 / 1M | キャッシュ入力 / 1M | 出力 / 1M |

|---|---|---|---|

| o3-mini | $1.10 | $0.55 | $4.40 |

| o1-mini | $3.00 | $1.50 | $12.00 |

| o1 | $15.00 | $7.50 | $60.00 |

| gpt-4o | $2.50 | $1.25 | $10.00 |

| gpt-4o-mini | $0.15 | $0.075 | $0.60 |

o3-miniは、もはや推論モデルですらないGPT-4oよりも安価であるため、少しでも複雑なタスクは、すべてo3-miniに投げとけばOK、と言っても過言ではない。

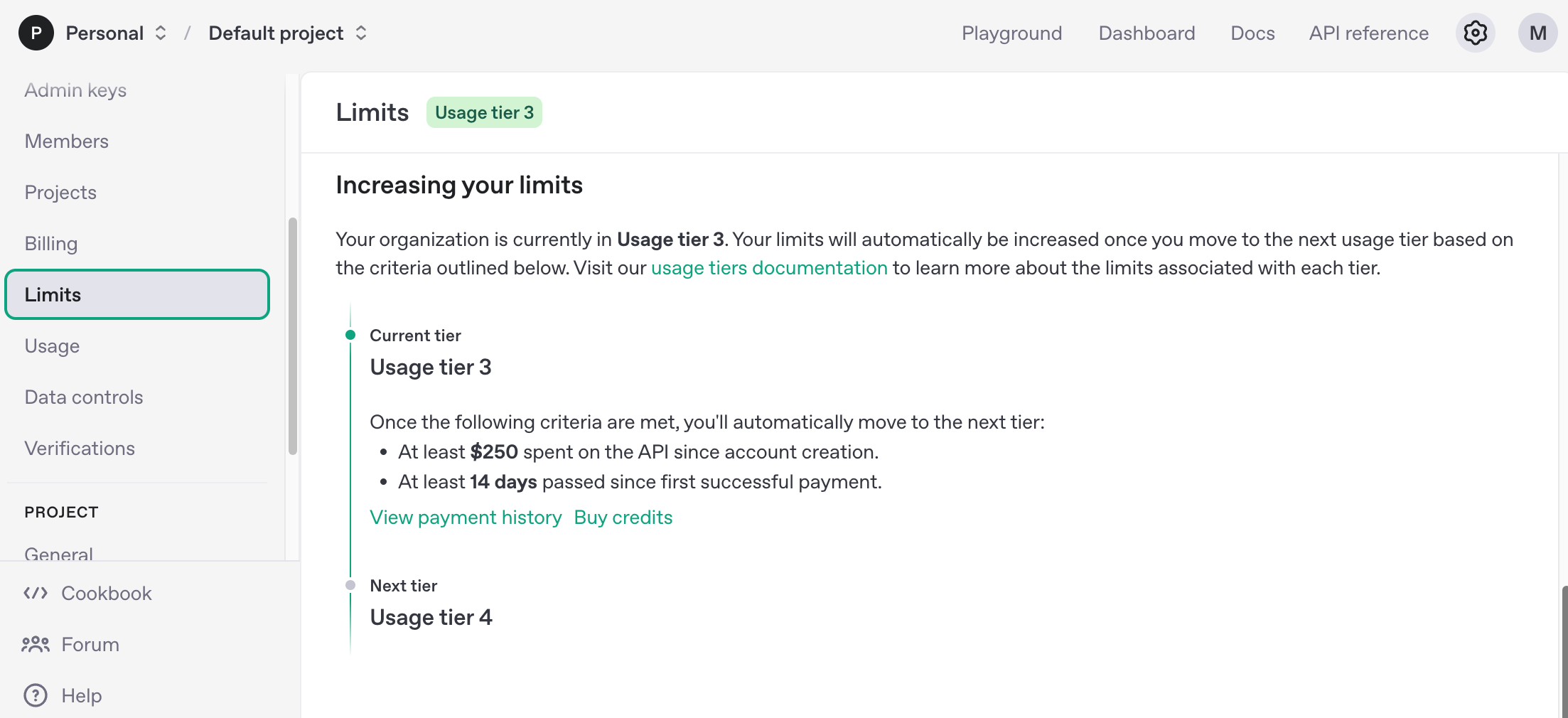

Tier 3-5の幅広いユーザーにAPIが開放

OpenAIのAPIは、過去に支払った料金に応じて、ユーザーの「Tier」がランク分けされている。Tierは、累積支払額と初回支払日からの経過日数に基づいて、自動的に昇格する。

| Tier | 必要支払額 | 経過期間要件 | 月間使用限度額 |

|---|---|---|---|

| Tier 1 | $5以上 | なし | $100 |

| Tier 2 | $50以上 | 7日以上 | $500 |

| Tier 3 | $100以上 | 7日以上 | $1,000 |

| Tier 4 | $250以上 | 14日以上 | $5,000 |

| Tier 5 | $1,000以上 | 30日以上 | $200,000 |

従来、o1モデルのAPIは、最上位であるTier 5のユーザーしか利用できなかった。

o3-miniは、Tier 3以上のユーザーにまで利用範囲が拡大したため、より多くの人がAPIで推論モデルを利用できるようになった。

現在、Tier 3以上のユーザーに対して、o3-miniが順次ロールアウトされており、記事執筆時点では、まだ全てのユーザーには行き渡っていないようだ。利用可能になり次第、メールが来るという。

o3-miniを使えるTier 3に最速で昇格する方法

ちなみに、Tier 3に最速で昇格したければ、アカウントに100ドルチャージして、1週間待つだけで良い。以前からアカウントを持っていた人は、100ドルチャージした瞬間に昇格する。

実際にAPIで100ドル分を消化しなくても、チャージしただけでランクは決定される。しかも、一度昇格すればその後もランクは維持される。

将来的にチャージ金額を使い切るのであれば、特に損もないので、API経由でo3-miniを使いたい人は、今のうちにTier 3に引き上げておくと良いだろう。

API経由で利用可能になれば、LibreChatやOpenWebUIなどの汎用チャットインターフェースを使って、月額サブスク不要で、o3-mini-highを好きなだけ利用できるので、メリットも大きい。

APIを利用するメリットについては、以下の記事も参考にしてほしい。

「推論モデル」が意味するもの:o3とGPT-4oは何が違うのか

OpenAIが開発する「o1」や「o3」、DeepSeekが開発する「R1」、Googleが開発する「Gemini-2-flash-thinking」などのモデルは、「推論モデル(reasoning model)」と呼ばれる。

推論モデルは、従来の代表的なモデルであるOpenAIのGPT-4oやGPT-3.5、AnthropicのClaude、GoogleのGemini 1.5などとは、全く異なるアプローチで性能の向上が図られている。

「o3-mini」が無料ユーザーでも利用できるようになった意義を理解するためにも、「推論モデル」が、これまでのモデルと何が違うのかを簡単に解説しておく。

「学習スケーリング」から「推論スケーリング」へのシフト

従来の大規模言語モデル(LLM)の性能向上は、主に大量のデータでの事前学習と、モデルサイズの巨大化によって成し遂げられてきた。

(=学習によるスケーリング)

しかし、この世界に存在する学習データの量には限界があるため、すでに各社のAIの性能は天井に達してしまった、という見方も多かった。

そんな中、事前の学習段階ではなく、アウトプットの段階で計算資源を追加で割り当てることで(例:自問自答を繰り返させる)、性能向上を実現する手段が開発された。

(=推論によるスケーリング)

事前学習(train-time)に計算資源を投じていた「Train Time Compute」の時代と対比して、推論時(test-time)に計算資源を投じる「Test Time Compute」の時代、などと表現されることもある。

その分、回答の生成に時間がかかる、というデメリットはあるが、o1やo3などの推論モデルは、GPT-4oなどの従来モデルよりも、ずっと複雑な問題を解くことが可能になっている。

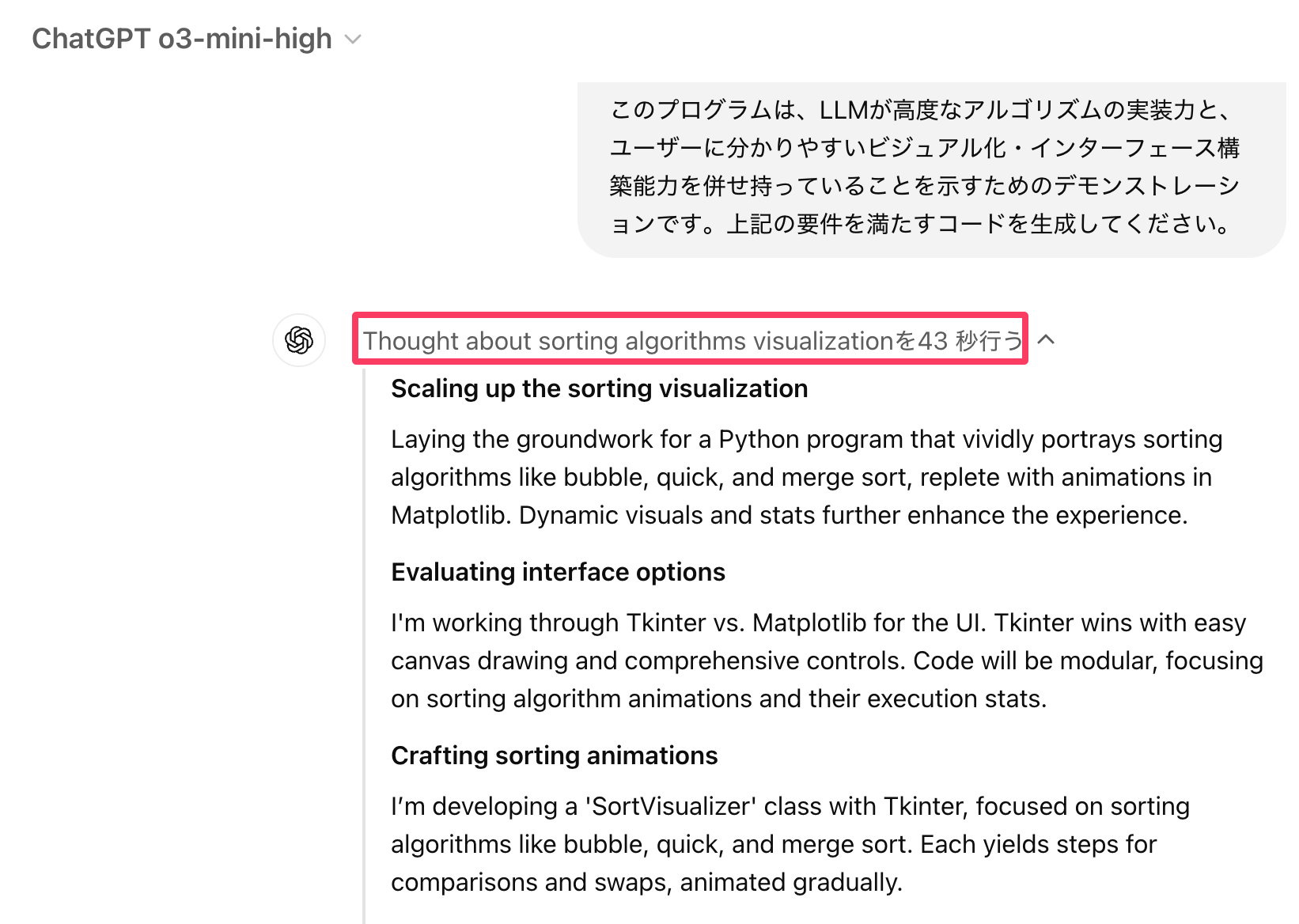

o3-miniの「Chain-of-Thought」を覗き見る

Test Time Compute(推論時計算)の具体の実装方法には様々あるが、最も人間にとって分かりやすく、象徴的なのが「Chain-of-Thought」だろう。

Chain-of-Thought(CoT)とは、最終的な回答をいきなり生成するのではなく、問題を複数のステップに分割し、まず各ステップでの思考内容を順番に生成してから、最後に回答を生成するアプローチだ。

論理の飛躍が起こりにくく、複雑な問題でも、正しい答えに辿り着ける可能性が高まる。

DeepSeekの推論モデル「R1(解説記事)」や、Googleの推論モデル「Gemini 2.0 Flash Thinking(解説記事)」などは、CoTが丸見えになっているので、CoTの仕組みを理解しやすい。例えば、DeepSeek R1に二桁の掛け算を聞いてみると、R1が自問自答しつつ、最適な解き方をいろいろ検討している様子が見て取れる。

開発者によって、思考内容のテキストを見せてくれるLLMもあれば、見せてくれないLLMもある。

ChatGPTのo3-miniは、現状、CoTをそのまま見せてはくれないが、CoTのサマリーを見せてくれる。

GPT-4oとo3-miniの使い分け方

o3-miniが無料ユーザーでも利用可能になったことで、より多くの人が推論スケーリングの恩恵に与ることができるようになった。

ただし、メールの下書き、くらいのシンプルな用途では、GPT-4oとo3-miniの違いを体感しにくいかもしれない。

数学の問題やプログラムの設計など、複雑な思考ステップを要するタスクでは、大きな違いを感じられるはずだ。

ちなみに、筆者の使用感としては、数学やコーディング以外も含め、殆どすべてのタスクで、推論モデルの方が強力だと感じている。

単なる文章作成や、長文の外国語の翻訳などにおいても、GPT-4oよりもo3-mini-highの方が、より正確にプロンプトの指示を守り、クオリティの高い文章を生成してくれる。

あまりにも単純な質問では、o3-miniの使用回数制限を消費してしまうのが勿体無いとしても、基本的には、全てo3-miniを使っておけば間違い無いだろう。

o3-miniリリース当日の公開Q&Aで語られたこと

o3-miniのリリース当日には、OpenAI代表のSam Altman氏や、チーフリサーチオフィサーのMark Chen氏など、OpenAIの主要な開発陣6名が、米掲示板サイトReddit上で、1時間限定のライブQ&Aイベントを行った。

「Ask Me Anything (AMA)」とは、Redditで昔からある定番のスレッドで、日本の2ちゃんねるで言うところの「〜だけど質問ある?」スレのようなものだ。

このスレッドでは、o3フルモデルや、o3-proモデルのリリース予定などについて、サムアルトマン氏が直接回答するなど、興味深いやり取りが多く見られた。

以下、o3シリーズに関連する箇所に絞って、AMAセッションの要点を紹介する。

o3 full のリリースは数ヶ月以内、o3 pro も予定あり

今回リリースされたのは、o3の小型版であるo3-miniだけだ。

o3の「フル版」がいつリリースされるのか、というユーザーの質問に対して、サムアルトマン氏が直接回答している。

それによれば、o3のリリースは、「数週間以上、数ヶ月以内」とのこと。

また、ChatGPTの月額200ドルのプランで利用できる「o1-pro」の後継、「o3-pro」についても、リリース時期は明言されなかったが、リリース予定があることだけは明言された。

o3-proは、これまでのOpenAIの発表やドキュメントの中では、その存在が言及されてこなかったたため、初情報と思われる。

サムアルトマン氏によれば、「o1 proにまあ価値があると思っている人は、o3 proは超価値がある(”super worth it”)と感じるはず」とのことで、o3-proの性能が楽しみだ。

有料プランの価格は据え置き、もしかすると値下げも?

どんどん新しいモデルが登場し、性能も向上していくので、現在月額20ドルのChatGPTのPlusプランが、いつか値上げされるのでは、と懸念する声もある。

値上げの予定はあるか、というユーザーからの質問に対しては、最高プロダクト責任者のKevin Weil氏が一言「Nope」とだけ返信しており、20ドルは維持される予定のようだ。

また、同じコメントに対して、サムアルトマン氏は、「むしろ値下げしたい」と返信している。

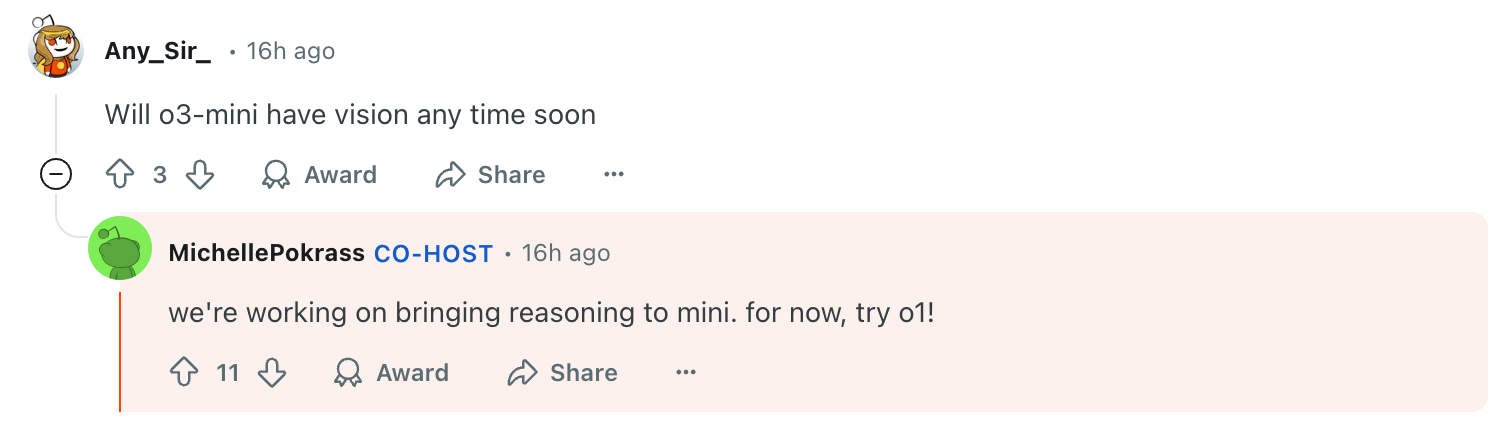

o3の画像・PDF・ファイル読み込み機能も今後実装予定

現状、ChatGPTで利用できるo3-miniでは、Web検索機能は利用できるものの、ファイルを添付することはできない。

ユーザーからも、ファイル読み込みに関する質問が多く集まった。

まず、画像の読み込みを可能とするVision機能は付くのか、と言う質問に対しては、o3-miniへの実装に向け準備しており、今のところo1を試してほしい、との回答だった。

PDFのアップロードについても、具体的な日付は言えないが、将来実装予定であると明言された。

また、o1, o3などの推論モデルに対して、ファイルのアップロード(画像やPDFだけでなくコードファイルなど)を可能とする予定はあるか、と言う問いに対しても、現在準備中と回答されている。

現在はo1のみで利用できる画像アップロード、またGPT-4oで利用できるPDFやファイルアップロードについても、o3-miniも将来対応予定とのことで、楽しみにしておきたい。